従来のStable Diffusionより大幅に強化された画像生成AI「Stable Diffusion XL」のベータ版がテスト公開されたので使ってみた

Stable Diffusionを開発したAI研究企業のStability AIが、従来の画像生成AIを大幅に強化した「Stable Diffusion XL(#SDXL)」をテストしていることが明らかになりました。Stability AIのウェブサービスである「DreamStudio」で、実際に「Stable Diffusion XL」のベータ版を使うことができたので、新たな画像生成モデルがどれほどの性能なのか試してみました。

Stable Diffusion XL #SDXL はパートナーとテスト中です!従来の9億パラメーターのSDより大きいモデルで、SDXLは23億パラメーター、色んな手法で改善しています♪ https://t.co/tm7uzR7FNI— Stability AI 日本公式 (@StabilityAI_JP) April 1, 2023

従来のStable Diffusionに含まれていたパラメーター数は9億でしたが、「Stable Diffusion XL」のパラメーター数は23億に達しているとのこと。「Stable Diffusion XL」のベータ版は、Stability AIのウェブサービスである「DreamStudio」で利用できます。

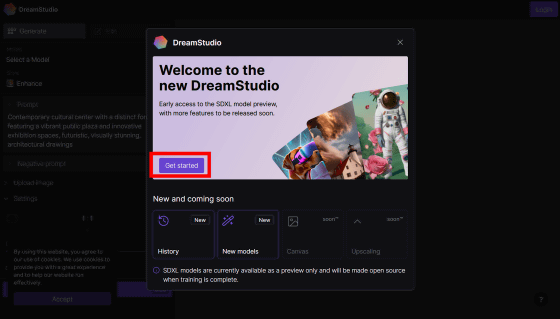

DreamStudioにアクセスすると、記事作成時点では以下のように「Stable Diffusion XL」のアーリーアクセスが可能になったことを告知するポップアップが表示されました。「Get Started」をクリック。

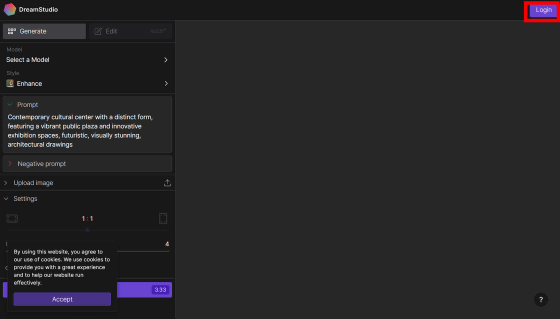

DreamStudioのアカウントを持っていない場合、新たにアカウントを登録する必要があります。右上の「Login」をクリック。

GoogleアカウントやDiscordアカウント、メールアドレスなどでアカウントを作ることが可能です。今回は「Continue with Google(Googleアカウントで続ける)」をクリック。

使用するアカウントを選択。

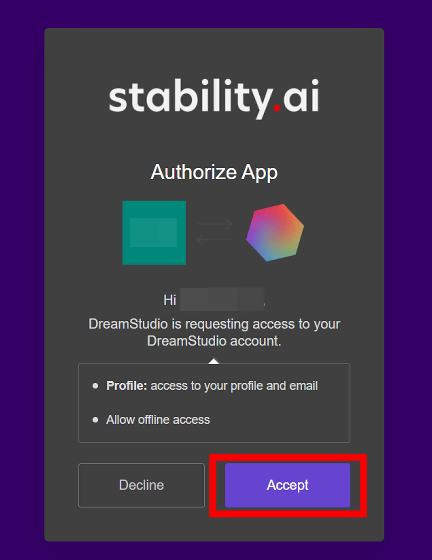

「Accept」をクリック。

これでアカウント開設は完了です。DreamStudioでは初回登録時に、デフォルト設定で約125枚の画像生成が可能となる25クレジットが与えられるため、この無料クレジットを使って「Stable Diffusion XL」を試すことができます。

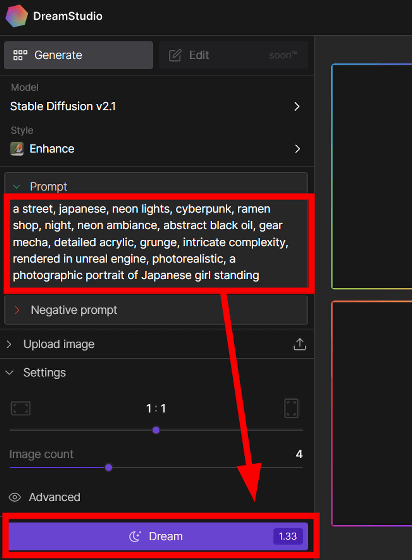

DreamStudioではベータ版の「Stable Diffusion XL」を含め、いくつかのStable Diffusionモデルを選択して使うことができます。左上の「Model」をクリックし、まずは従来版である「Stable Diffusion v2.1(バージョン2.1)」を選択。

今回は、Stable DiffusionやMidjourneyのプロンプトを写真やイラストから検索できる「unprompt.ai」で見つけたプロンプトを微修正し、シード値やステップ数はデフォルトのままで画像を生成してみます。プロンプトを入力したら「Dream」をクリック。

利用規約を確認するよう求められるので、確認したら「I agree to the Terms of Service(利用規約に同意します)」にチェックを入れて「Accept」をクリック。

すると、4枚の画像が生成されました。

4枚の画像を並べてみるとこんな感じ。

続いてモデルを「SDXL Beta(Stable Diffusion XLベータ版)」に変更し、同じプロンプトと設定で画像を生成してみることにします。なお、必要なクレジット数は「Stable Diffusion v2.1」と比較して2倍以上増えているため、クレジットの消費量には注意が必要です。

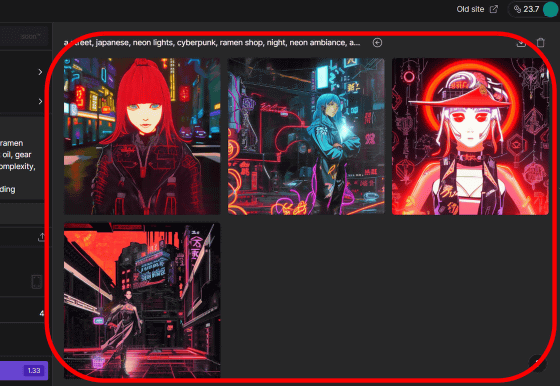

「SDXL Beta」で生成してみた画像はこんな感じ。

4枚の画像を並べてみました。驚くほどにクオリティの高い画像が生成され、「Stable Diffusion XL」の威力をまざまざと実感しました。

なお、Stable Diffusion XLはトレーニングの終了後にオープンソース化される予定ですが、その際の名称は「Stable Diffusion XL」ではない可能性があるとのことです。