アリババが画像&動画生成AI「Wan 2.1」の一部モデルをオープンソースで公開

アリババグループのTongyi Labが開発する高度で強力なビジュアル生成モデル「Wan」のバージョン2.1のうち、4つのモデルがオープンソース化されました。

Alibaba makes AI video generation model free to use globally

https://www.cnbc.com/2025/02/26/alibaba-makes-ai-video-generation-model-free-to-use-globally.html

https://www.engadget.com/ai/alibaba-offers-free-access-to-its-ai-model-that-can-generate-realistic-video-and-images-133045633.html

Alibaba makes AI model for video, image generation publicly available | Reuters

https://www.reuters.com/technology/artificial-intelligence/alibaba-release-open-source-version-video-generating-ai-model-2025-02-25/

現地時間の2025年2月26日、アリババがオープンソース化を予告していたWan 2.1のうち4つのモデルをオープンソース化しました。当初、アリババはこのモデルを「WanX 2.1」と呼称していましたが、後に「Wan 2.1」に名称を短縮しています。今回アリババがオープンソース化したのは、Wan 2.1のうち「T2V-1.3B」「T2V-14B」「I2V-14B-720P」「I2V-14B-480P」という4つのモデル。モデル名に含まれる「14B」は「パラメーター数が140億」であることを示しています。

🌟 Big News from @alibaba_cloud! 🌟

Meet WanX - our next-gen AI model redefining video generation !

🚀 Presenting mind-blowing demos from WanX 2.1!

🔥 Even more exciting:

WanX 2.1 will be OPEN-SOURCE !

Coming soon …#AIart #OpenSource pic.twitter.com/R1laOyJYAL— Wan (@Alibaba_Wan) February 20, 2025

Wan 2.1は動画生成モデルの包括的なベンチマークとして知られるVBenchにおいてトップの成績を獲得しており、特にマルチオブジェクトインタラクションなどの機能が優れている模様。

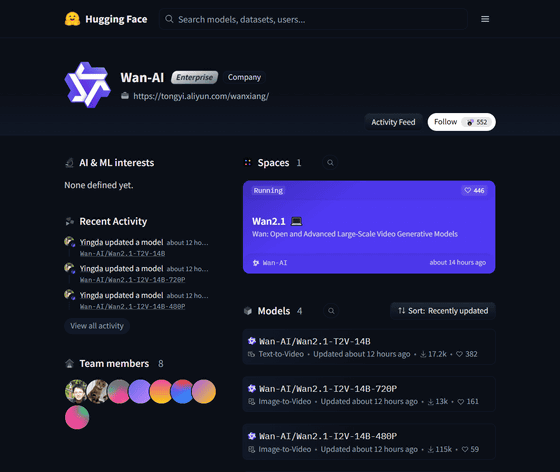

オープンソース化されたモデルはAlibaba CloudのModelScopeと、AIモデルの巨大リポジトリとして知られるHugging Faceを通じて利用可能です。

Wan-AI (Wan-AI)

https://huggingface.co/Wan-AI

Wan 2.1はオープンソース化されたため、GitHub上でソースコードが公開されています。

GitHub - Wan-Video/Wan2.1: Wan: Open and Advanced Large-Scale Video

Generative Models

https://github.com/Wan-Video/Wan2.1

2025年1月に中国のDeepSeekが発表した推論モデルのR1は、OpenAIの推論モデルであるo1と比較してトレーニングコストがわずか3%であることが話題を呼びました。これ以来、オープンソースのAIモデルが世界中から注目を集めています。

DeepSeekはどのようにしてOpenAIの3%のコストでo1を超えたのか? - GIGAZINE

オープンソースのモデルはOpenAIのクローズドモデルと異なり企業に直接収益をもたらすことはありません。しかし、テクノロジーをオープンソース化することはイノベーションの推進や製品を中心としたコミュニティの構築など、さまざまな目的に役立ちます。

特に中国企業はオープンソースモデルを推進しており、アリババとDeepSeekのモデルは世界で最も使われるモデルになっているとのこと。アリババは2023年8月に最初のオープンソースモデルを公開しました。

なお、中国企業以外ではMetaがオープンソースのAIモデルを推進しています。

MetaがAIモデル「Llama 3.3」をリリース、70BモデルでLlama 3.1の405Bモデルに匹敵する性能を発揮 - GIGAZINE